R1-Zero 等模型正在打破人类数据瓶颈,开启 AI 自我进化新范式?

「比起 R1,DeepSeek 同一时间发布的 R1-Zero 更值得关注。」这是 ARC Prize 联合创始人 Mike Knoop 在一篇新博客中发表的观点。他认为,R1-Zero 之所以比 R1 更值得分析,是因为它完全依赖强化学习(RL),而不使用人类专家标注的监督微调(SFT),这表明在某些任务中,人类标注并非必要,且未来可能通过纯 RL 方法实现更广泛的推理能力。此外,R1 和 R1-Zero 的成功还能让我们读出一些信息,比如:

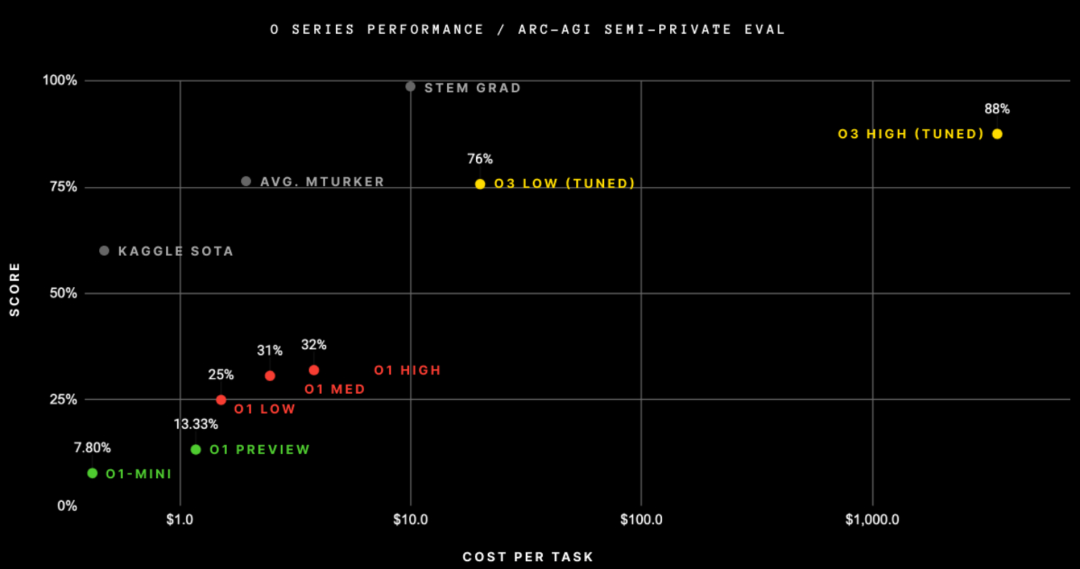

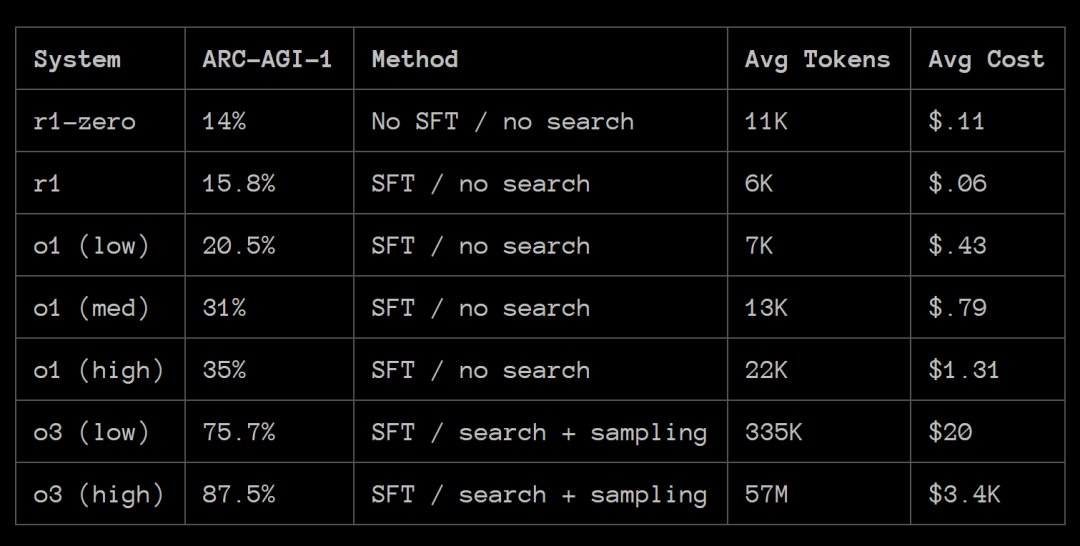

上周,DeepSeek 发布了他们新的「推理」系统 R1-Zero 和 R1,两个模型在 ARC-AGI-1 上的得分与 OpenAI 的 o1 系统低计算量版本相当。R1-Zero、R1 和 o1(低计算量模式)的得分都在 15-20% 左右。相比之下,纯 LLM scaling 多年积累的顶点 GPT-4o 仅为 5%。根据本周美国市场反应,公众也开始理解纯 LLM scaling 的局限性。然而,对即将到来的推理需求,公众仍普遍认识不足。尽管 o3 在 ARC-AGI-1 上取得胜利是重大科技新闻,但主流媒体几乎未予报道。这是 AI 领域和计算机科学的一个极其重要的时刻,这些系统值得研究。但由于 o1/o3 的封闭性质,只能依靠推测。得益于 ARC-AGI-1 和现在(几乎)开源的 R1-Zero 和 R1,我们可以增进对此的理解(说「几乎」是因为 DeepSeek 没有发布一个可复现的方式来从头开始生成他们的模型权重)。特别是,R1-Zero 比 R1 重要得多。在对 o1 和 o3 的分析中,ARC Prize 团队针对这些推理系统的工作原理进行了推测。他们认为,这些模型的关键思路可能是:

为问题域生成思维链(CoT)。

使用人类专家(「监督微调」或 SFT)和自动化机器(强化学习(RL))的组合来标注中间 CoT 步骤。

使用(2)得到的数据训练基础模型。

在测试时,从过程模型中进行迭代推理。

下图回顾了各模型迭代采样所使用的技术及其在 ARC-AGI-1 上的得分:有了 DeepSeek 新发表的研究,ARC Prize 团队可以更好地为自己的猜测提供信息。这里的关键见解是,LLM 推理系统实现更高程度地适应新任务的能力(和可靠性)是通过三个维度实现的:

在 CoT 过程模型训练中添加人类标签(即 SFT);

使用 CoT 搜索而不是线性推理(并行逐步 CoT 推理);

Cliclic AI

Cliclic商品背景图编辑器是一款功能强大的AI工具,帮助用户快速生成具有吸引力的商品图背景。

下载

整体 CoT 采样(并行轨迹推理)。

维度 1 受限于人类数据生成,并限制了这些推理系统在哪些领域收益最大。例如,o1 在 MMLU 专业法律类别上的表现出人意料地比数学和逻辑要低得多。维度 2、3 受限于效率。o1 和 o3 在测试时都显示了随着推理计算量的增加,在 ARC-AGI-1 上的基准准确率呈对数增长,而不同的计算资源分配策略会影响达到同样性能水平所需要的具体计算量。在该团队看来,DeepSeek 最有趣的做法是单独发布 R1-Zero。R1-Zero 是一个不使用 SFT(维度 1)的模型,而是完全依赖于强化学习。R1-Zero 和 R1 在 ARC-AGI-1 上的得分高度一致,分别为 14% 和 15.8%。DeepSeek 自己报告的基准测试分数也显示 R1-Zero 和 R1 高度一致,例如在 MATH AIME 2024 上的得分分别为 71% 和 76%(相比基础 DeepSeek V3 的约 40% 有所提升)。在论文中,R1-Zero 的作者提到「DeepSeek-R1-Zero 面临可读性差、语言混杂等挑战」,这一点已在网上得到证实。然而在测试中,ARC Prize 团队在测试 R1-Zero 在 ARC-AGI-1 上的表现时几乎没有发现不连贯的证据,这与系统经过 RL 训练的数学和代码领域相似。

在那些能够清晰判断对错的领域中 ,SFT(如人类专家标注)对于准确和易读的 CoT 推理并非必需。

R1-Zero 训练过程能够通过 RL 优化在 token 空间中创建自己的内部领域特定语言(DSL)。

SFT 是提高 CoT 推理领域泛化性的必要条件。

这很符合直觉,因为语言本身实际上就是一个推理 DSL。完全相同的「词语」可以在一个领域中学习并应用到另一个领域,就像程序一样。纯 RL 方法还不能发现广泛共享的词汇表,预计这将成为未来研究的重点。最终,R1-Zero 展示了一个潜在 scaling 机制的原型,该机制完全没有人类瓶颈 —— 甚至在训练数据获取本身也是如此。几乎可以肯定的是,DeepSeek 已将目标对准了 OpenAI 的 o3 系统。重要的是要关注 SFT 是否最终会成为添加 CoT 搜索和采样的必要条件,或者假设的「R2-Zero」是否可能沿着相同的对数准确率与推理 scaling 曲线存在。基于 R1-Zero 的结果,ARC Prize 团队认为在这个假设的 scaled up 版本中,要在 ARC-AGI-1 上挑战成功并不需要 SFT。

现在可以花更多钱来获得更高的准确性和可靠性;

训练成本正在转向推理成本。

这两者都将推动对推理的大量需求,而且都不会抑制对更多计算能力的需求。实际上,它们将增加对计算能力的需求。AI 推理系统带来的价值远不止提高基准测试的分数那么简单。阻碍更多 AI 自动化使用(例如推理需求)的首要问题是可靠性。ARC Prize 团队与数百位试图在业务中部署 AI 智能体的 Zapier 客户交谈,反馈高度一致:「我还不信任它们,因为它们工作不可靠」。此前 ARC Prize 团队认为,模型在 ARC-AGI 方面的进展将提高可靠性。LLM 智能体的挑战在于它们需要强大的本地领域引导才能可靠工作。更强的泛化能力需要适应未见情况的能力。现在有证据表明 ARC Prize 团队的观点是正确的。因此,多家公司(Anthropic、OpenAI、Apple 等)现在推出智能体也就不足为奇了。出于可靠性需求,智能体将推动近期推理需求的显著增长。更广泛地说,开发者可以选择花费更多计算来增加用户对系统的信任。提高可靠性并不代表能做到百分百正确,但至少能保证即使犯错,也是以一种可预期的方式犯错。这没有问题,因为当准确率低时,用户和开发者现在可以通过提示更自信地引导行为。以前计算机无法解决的问题现在都有了对应的价格标签。随着效率的提高,这些价格会降低。推理即训练:推理将成 AI 模型的「数据永动机」? 另一个正在发生的重大转变是进入 LLM 系统预训练的数据来源。此前,大多数数据要么是购买的,要么是抓取的,要么是从现有 LLM 合成生成的(例如蒸馏或增强)。这些推理系统提供了一个新选择,即生成「真实」数据而不是「合成」数据。AI 行业使用「合成」一词来指代通常通过 LLM 循环来增加整体训练数据量的低质量数据,但收益递减。 但现在,通过推理系统和验证器,我们可以创造全新的、有价值的训练数据。这种数据的产生有两种方式:要么是开发者提前付费生成,要么是在用户实际使用系统时由用户付费生成! 这是一个引人深思的经济模式转变,暗示着拥有最多付费用户的 AI 系统开发商可能会拥有一个实力快速积累的关键时刻。这些付费用户实际上在为创造新的高质量数据买单..…… 这些数据又会让模型变得更好..…… 更好的模型会吸引更多用户青睐..…… 如此形成良性循环。 如果能够突破人类专家 CoT 障碍,创建一个极其高效的系统,通过搜索 / 合成和验证来创建新数据,那么应该预期会有大量计算投入这些推理系统,因为它们实际上只需要输入资金和原始数据就能变得更好。最终,这种类型的 AI 训练将完全超越在人类生成数据上进行的预训练。随着推理需求增加变得明显,市场调整将继续发生。AI 系统效率只会推动更多使用,这不仅是由于杰文斯悖论,还因为效率提高时新的训练机制被解锁(注:杰文斯悖论指的是:当技术进步提高了资源使用效率时,反而可能导致该资源的总消耗量增加,而不是减少)。随着 R1 的开源和可复现,更多人和团队将把 CoT 和搜索推向极限。这将更快地告诉我们前沿实际在哪里,并将推动一波创新浪潮,增加快速实现 AGI 的机会。已经有多人告诉 ARC Prize 团队,他们计划在 ARC Prize 2025 中使用 R1 风格的系统。R1 的开源对世界来说是一件好事。DeepSeek 推动了科学的前沿。原文链接:https://arcprize.org/blog/r1-zero-r1-results-analysis