polaformer:一种极性感知线性注意力机制,赋能高效视觉transformer

AIxiv专栏持续报道全球顶尖AI研究成果,本文介绍哈尔滨工业大学(深圳)与鹏城实验室联合培养博士生孟维康及其导师张正教授团队的最新研究:PolaFormer。该研究提出了一种新型的极性感知线性注意力机制,有效提升了视觉Transformer的性能和计算效率。

☞☞☞AI 智能聊天, 问答助手, AI 智能搜索, 免费无限量使用 DeepSeek R1 模型☜☜☜

研究背景:视觉Transformer的效率瓶颈

Vision Transformer及其变体在视觉任务中表现出色,但其自注意力机制的二次方复杂度限制了其在处理长序列或高分辨率图像时的效率。线性注意力机制通过替代softmax函数来降低复杂度,但现有方法存在不足:忽略负值信息,导致注意力权重分布信息熵过高。

PolaFormer的创新之处:极性感知与信息熵控制

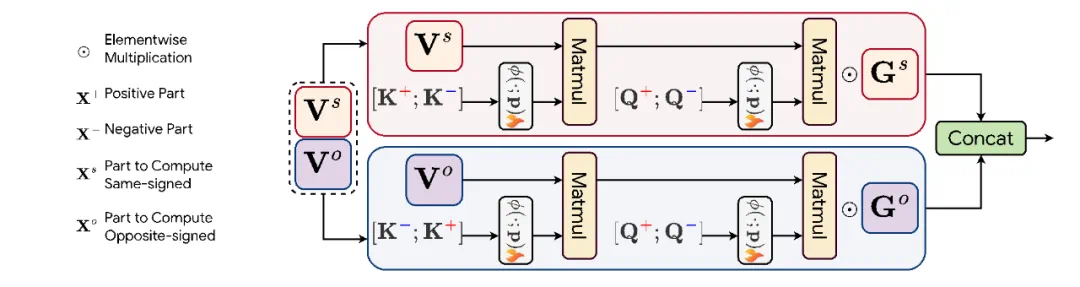

PolaFormer巧妙地解决了以上问题。它首先提出极性感知线性注意力,将查询向量(query)和键向量(key)分解为正负部分,分别计算正负相似度,避免了现有方法忽略负值信息的缺陷,从而更准确地捕捉特征间的关联。

其次,PolaFormer利用可学习的幂函数来降低注意力权重分布的信息熵,并通过数学证明支撑了该方法的有效性。这使得模型能够更有效地区分重要特征,提升性能。

实验结果:显著性能提升

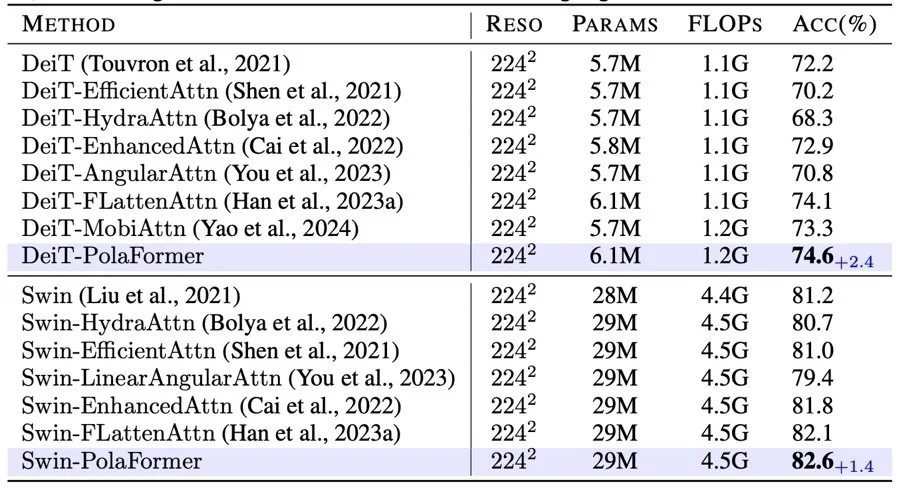

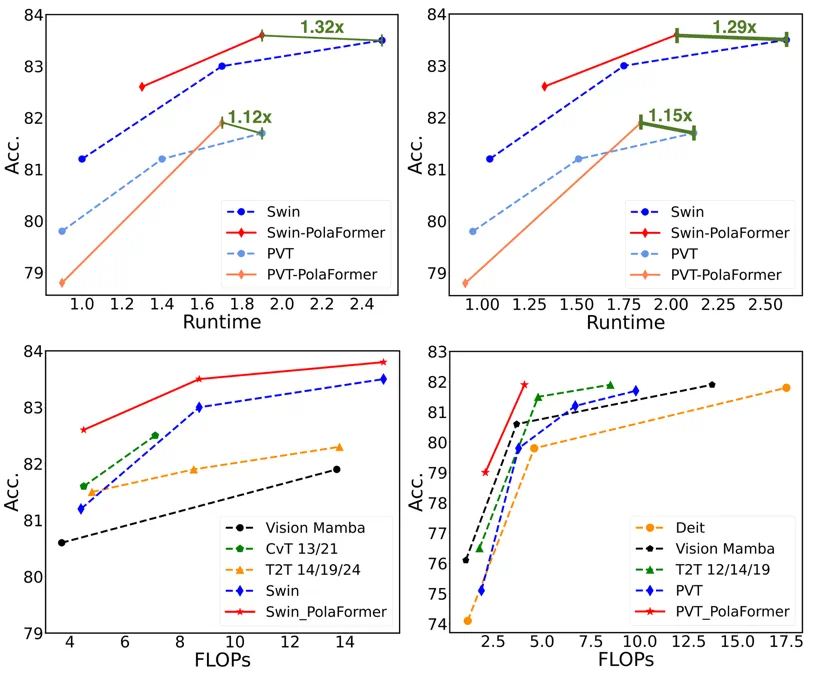

在图像分类、目标检测、实例分割和语义分割等视觉任务以及LRA任务上,PolaFormer均取得了显著的性能提升,证明了其有效性。

论文及代码:

- 论文标题:PolaFormer: Polarity-aware Linear Attention for Vision Transformers

- 论文链接:https://www.php.cn/link/460c9b5698f98c052062fd25e2b2f6de

- GitHub 链接:https://www.php.cn/link/ef32f86e6f9bbe45d945de2b11e5039a

- Huggingface 权重链接:https://www.php.cn/link/6358390c66d2575ac3607502a92e34af

团队信息:

- 第一作者: 孟维康 (哈尔滨工业大学(深圳)与鹏城实验室联合培养博士生)

- 通讯作者: 张正 教授 (哈尔滨工业大学(深圳)长聘教授)

- 课题组: Big Media Intelligence (BMI) https://www.php.cn/link/945e6b1aaf303dfdaf3c13fe0e08c02a

PolaFormer为高效视觉Transformer的研究提供了新的思路,其在提升计算效率的同时,也显著提高了模型性能,具有重要的学术价值和应用前景。 欢迎感兴趣的读者访问相关链接了解更多细节。