现在很多AI应用模型,都不得不提到一个模型结构:

Transformer。

它抛弃了传统的CNN和RNN,完全由Attention机制组成。

Transformer不仅赋予了各种AI应用模型写文作诗的功能,而且在多模态方面也大放异彩。

尤其是ViT(Vision Transformer)出来之后,CV和NLP之间的模型壁垒被打破,仅使用Transformer一个模型就能够处理多模态的任务。

(谁看完不得感叹一句它的强大啊)

虽然一开始Transformer是为语言任务而设计的,但它在模仿大脑方面也有着很大的潜力。

这不,有位科学作家写了篇博客,就是关于Transformer是如何进行大脑建模的。

☞☞☞AI 智能聊天, 问答助手, AI 智能搜索, 免费无限量使用 DeepSeek R1 模型☜☜☜

来康康他是怎么说的?

Transformer:做大脑做的事

首先,还得梳理一下它的演变过程。

Transformer机制在5年前首次出现,它能够有这么强大的表现,很大程度上归功于其Self-attention机制。

至于Transformer是如何模仿大脑的,继续往下看。

在2020年,奥地利计算机科学家Sepp Hochreiter的研究团队利用Transformer重组了Hopfield神经网络 (一种记忆检索模型,HNN)。

其实,Hopfield神经网络在40年前就已经被提出,而研究团队之所以时隔数十年选择重组这个模型原因如下:

其一,这个网络遵循一个普遍的规律:同时活跃的神经元之间彼此会建立很强的联系。

其二,Hopfield神经网络在检索记忆的过程中与Transformer执行Self-attention机制时有一定的相似之处。

所以研究团队便将HNN进行重组,让各个神经元之间建立更好的联系,以便存储和检索更多的记忆。

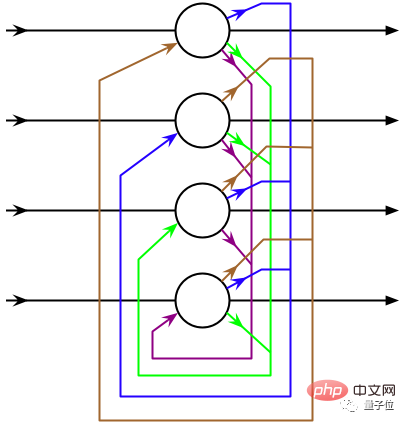

重组的过程,简单来说,就是把Transformer的注意力机制融合进HNN,使原来不连续的HNN变为可连续态。

△图源:维基百科

重组之后的Hopfield网络可以作为层集成到深度学习架构中,以允许存储和访问原始输入数据、中间结果等。

因此,Hopfield本人和麻省理工学院沃森人工智能实验室的Dmitry Krotov都称:

基于Transformer的Hopfield神经网络在生物学上是合理的。

虽说这在一定程度上与大脑的工作原理相像,但在某些方面还不够准确。

因此,计算神经科学家Whittington和Behrens调整了Hochreiter的方法,对重组后的Hopfield网络做出了一些修正,进一步提高了该模型在神经科学任务中(复制大脑中的神经放电模式)的表现。

△Tim Behrens (左) James Whittington(右) 图源:quantamagazine

简单来说,就是在编码-解码时,模型不再把记忆编码为线性序列,而是将其编码为高维空间中的坐标。

具体而言,就是在模型中引入了TEM(Tolman-Eichenbaum Machine)。

TEM是为了模仿海马体的空间导航作用而构建的一个关联记忆系统。

它能够概括空间和非空间的结构知识,预测在空间和关联记忆任务中观察到的神经元表现,并解释在海马和内嗅皮层中的重新映射现象。

将拥有这么多功能的TEM与Transformer合并,组成TEM-transformer(TEM-t)。

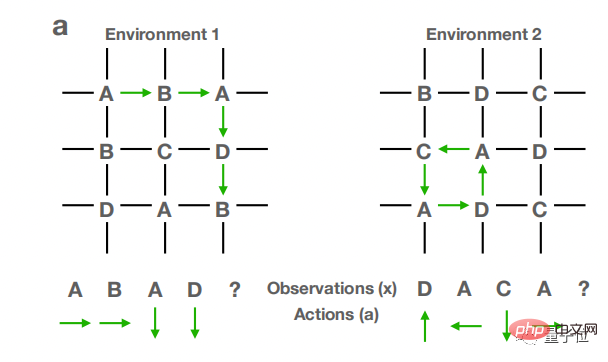

然后,再让TEM-t模型在多个不同的空间环境中进行训练,环境的结构如下图所示。

在TEM-t中,它依旧拥有Transformer的Self-attention机制。这样一来,模型的学习成果便能迁移到新环境中,用于预测新的空间结构。

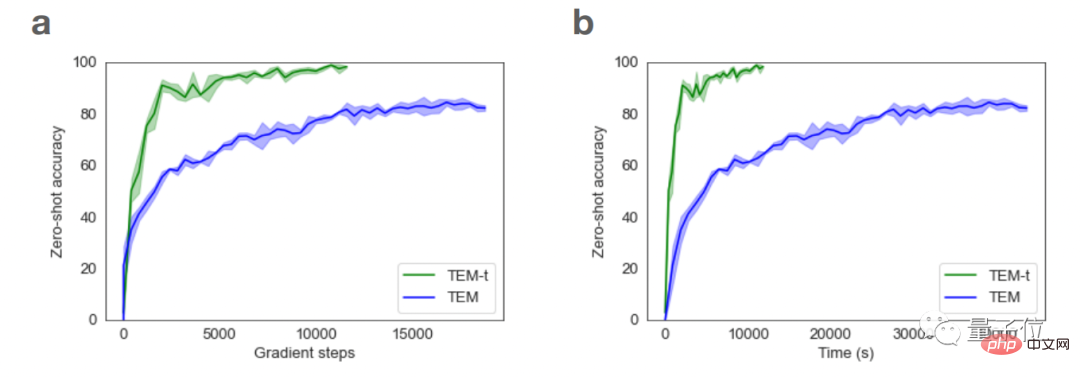

研究也显示,相较于TEM,TEM-t在进行神经科学任务时效率更高,而且它也能在更少学习样本的情况下处理更多的问题。

Transformer在模仿大脑模式的道路上越来越深入,其实换句话说,Transformer模式的发展也在不断促进我们理解大脑功能的运作原理。

不仅如此,在某些方面,Transformer还能提高我们对大脑其他功能的理解。

Transformer帮助我们理解大脑

比如说,在去年,计算神经科学家Martin Schrimpf分析了43种不同的神经网络模型,以观察它们对人类神经活动测量结果:功能磁共振成像(fMRI)和皮层脑电图(EEG)报告的预测能力。

其中,Transformer模型几乎可以预测成像中发现的所有变化。

倒推一下,或许我们也可以从Transformer模型中预见大脑对应功能的运作。

除此之外,最近计算机科学家Yujin Tang和 David Ha设计了一个模型,可以通过Transformer模型以随机、无序的方式有意识地发送大量数据,模拟人体如何向大脑传输感官观察结果。

这个Transformer就像人类的大脑一样,能够成功地处理无序的信息流。

虽然Transformer模型在不断进步,但也只是朝着精确大脑模型迈出的一小步,到达终点还需要更深入的研究。

如果想详细了解Transformer是如何模仿人脑的,可以戳下方链接~

参考链接:

[1]https://www.quantamagazine.org/how-ai-transformers-mimic-parts-of-the-brain-20220912/

[2]https://www.pnas.org/doi/10.1073/pnas.2105646118

[3]https://openreview.net/forum?id=B8DVo9B1YE0